自动驾驶是人工智能与交通领域的交叉前沿,其核心是通过传感器数据采集、环境感知、决策规划与控制执行,实现车辆的自主驾驶。然而,这一过程涉及海量数据处理、复杂模型训练与实时推理,对算力的需求呈指数级增长。据统计,L4级自动驾驶车辆每小时产生的原始数据量达4TB,而训练一个可靠的感知模型需消耗数万GPU小时。本文将结合自动驾驶的感知、决策、仿真测试三大环节,解析算力服务如何突破技术瓶颈,推动自动驾驶从实验室走向规模化商用。

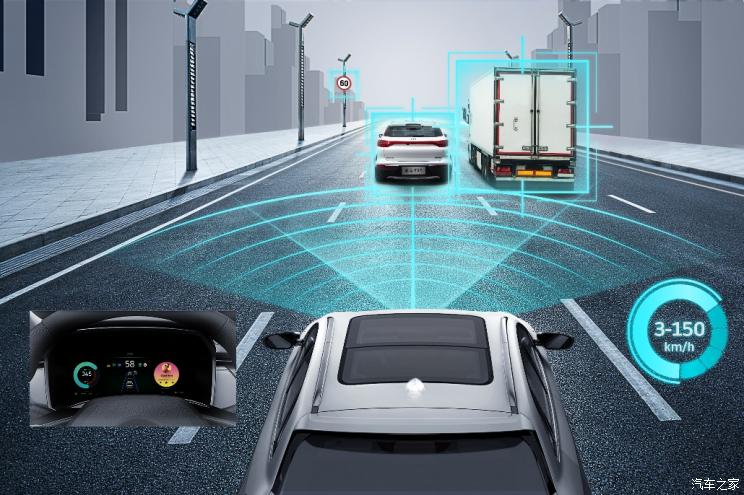

自动驾驶的感知系统需通过摄像头、激光雷达、毫米波雷达等多传感器融合,实时识别道路、车辆、行人、交通标志等目标。这一过程涉及三大算力密集型任务:

摄像头产生的图像数据需进行去噪、畸变校正;激光雷达的点云数据需进行滤波、地面分割;毫米波雷达的反射信号需进行多目标跟踪。不同传感器的数据需在时间与空间上对齐,以构建统一的环境模型。算力需求:

实时性:需在100ms内完成所有传感器的数据预处理,否则会导致决策延迟。

并行计算:图像处理需GPU加速(如CUDA核心),点云处理需CPU多线程与向量指令集(如AVX-512)。

异构计算优化:通过算力平台自动分配任务至GPU(图像)、FPGA(点云)、ASIC(编码)等不同硬件,提升处理效率。例如,某自动驾驶公司通过算力服务将传感器数据预处理时间从120ms压缩至65ms,系统响应速度提升46%。

动态资源调度:根据车辆行驶场景(高速/城市)动态调整算力分配。例如,高速场景下减少激光雷达点云处理算力,优先保障摄像头图像的实时分析。

感知模型需识别道路上的各类目标(如车辆、行人、自行车),并分割出可行驶区域、车道线等语义信息。主流方法包括基于卷积神经网络(CNN)的二维检测(如YOLOv8)、基于点云的三维检测(如PointPillars)以及多模态融合模型(如BEVFusion)。算力需求:

模型复杂度:BEVFusion等模型参数量超1亿,单次推理需消耗数百TOPS(每秒万亿次操作)算力。

低延迟要求:需在100ms内完成所有目标的检测与分割,否则会影响决策规划的及时性。

模型压缩与量化:通过算力平台提供的工具链(如TensorRT),将模型从FP32精度压缩至INT8,推理速度提升3-5倍,同时保持95%以上的准确率。例如,某车企通过模型量化将感知模块的算力需求从200TOPS降至80TOPS,可适配更低功耗的嵌入式平台。

分布式推理:将模型拆解为多个子模块(如特征提取、目标检测、语义分割),分配至不同计算节点并行执行。例如,在云端通过8卡GPU并行推理,将单帧处理时间从150ms降至30ms。

多传感器数据需在时间(不同传感器的采样频率差异)与空间(摄像头与激光雷达的坐标系差异)上对齐,以消除感知误差。例如,摄像头以30FPS采样,激光雷达以10FPS采样,需通过插值与外推实现时间同步。算力需求:

高精度计算:时空对齐需处理浮点数运算(如坐标变换、时间戳插值),对CPU的浮点运算能力要求高。

实时性:需在50ms内完成所有传感器的融合,否则会导致决策模块接收到的环境模型“过时”。

专用硬件加速:通过算力平台提供的FPGA或ASIC芯片,加速浮点运算与坐标变换。例如,某供应商推出的传感器融合加速卡,可将时空对齐的算力需求从10TOPS降至2TOPS,功耗降低80%。

流式计算框架:结合Apache Flink等流处理引擎,实现传感器数据的“边采集边融合”,减少中间缓存带来的延迟。

决策规划模块需根据感知系统输出的环境模型,生成车辆的行驶轨迹(如跟车、变道、避障)。传统方法依赖预设规则(如交通法规、安全距离),但难以应对复杂场景(如无保护左转、行人突然横穿)。而数据驱动的方法(如强化学习、模仿学习)需通过海量仿真数据训练决策模型,对算力的需求远超感知环节。

决策系统需预测周围车辆、行人的未来轨迹(如未来3秒内的位置),以提前规划避让或跟车策略。主流方法包括基于LSTM的时间序列预测、基于图神经网络(GNN)的交互建模。算力需求:

大规模并行计算:需同时预测数百个交通参与者的轨迹,单次推理需处理数万维的输入特征(如位置、速度、历史轨迹)。

GPU集群加速:通过算力平台提供的千卡级GPU集群,并行训练与推理轨迹预测模型。例如,某公司通过1024张A100 GPU训练模型,将训练时间从30天压缩至3天,推理速度提升10倍。

稀疏化计算:利用TensorFlow的稀疏算子或PyTorch的稀疏张量,减少无效计算(如远距离目标的低相关性特征)。

路径规划需在满足安全约束(如避免碰撞、保持车距)的前提下,优化行驶效率(如最短时间、最低能耗)。主流方法包括基于采样的规划(如RRT*)、基于优化的规划(如MPC)以及数据驱动的规划(如深度强化学习)。算力需求:

高维搜索空间:RRT*等采样方法需在6维状态空间(x,y,z,θ,v,ω)中搜索路径,计算复杂度随维度指数增长。

专用规划芯片:通过算力平台提供的ASIC芯片(如特斯拉FSD),将路径规划的算力需求从100TOPS降至20TOPS,同时支持多目标并行优化。

分层规划架构:将全局路径规划(如导航路线)与局部路径规划(如避障)解耦,全局规划在云端完成(算力需求低),局部规划在车端完成(算力需求高),降低整体算力成本。

强化学习通过让智能体在仿真环境中“试错”学习最优策略,但需消耗海量算力。例如,训练一个L4级自动驾驶决策模型需在仿线亿公里,相当于现实世界中100辆车不间断行驶1年。算力需求:

海量仿真:需同时运行数千个仿真环境,每个环境模拟不同的交通场景(如雨天、夜间、拥堵)。

模型更新:需频繁调整强化学习模型的参数(如策略网络、价值网络),以适应新场景。

分布式仿真平台:通过算力平台提供的容器化技术(如Kubernetes),并行运行数万个仿线个月。例如,某公司通过5000个Docker容器同时仿线万公里的虚拟行驶。

异步训练优化:利用算力平台的分布式框架(如Horovod),实现多个仿真环境的梯度聚合,提升训练效率。

自动驾驶需通过大量测试验证安全性,但实车路测成本高(每公里成本超1美元)、效率低(覆盖所有场景需行驶数亿公里)。而仿真测试可通过数字孪生技术,在虚拟环境中复现极端场景(如儿童突然冲出、前方车辆急刹),但需消耗海量算力构建高精度仿线. 高精度场景建模:从“简单道路”到“复杂城市”的仿真

仿真环境需构建包含道路、车辆、行人、交通信号的3D场景,并模拟物理特性(如摩擦力、光照)。主流工具包括CARLA、Prescan等,但单场景渲染需消耗数GB显存。

:通过算力平台提供的RTX A6000等显卡,利用光线追踪技术提升场景真实度,同时将渲染时间从50ms压缩至10ms。

:将物理计算分配至多个CPU核心,支持大规模车辆与行人的交互仿真。例如,某仿线核CPU并行计算,可同时模拟1000辆车的物理行为。

实车路测中,极端场景(如“鬼探头”)发生概率低,难以通过自然驾驶数据覆盖。而仿真测试可通过算法主动生成极端场景,但需运行生成模型(如GAN、扩散模型)与验证模型(如感知模型、决策模型)。

:需训练GAN生成逼真的行人行为、车辆轨迹,单次训练需消耗数千GPU小时。

:通过算力平台提供的预训练模型(如行人行为GAN),快速生成极端场景,减少训练成本。例如,某公司利用预训练模型将场景生成时间从72小时压缩至2小时。

:结合CI/CD工具(如Jenkins),实现“场景生成-模型验证-报告生成”的全自动化,提升测试效率。

HIL测试需将真实车辆控制器(如ECU)与仿真环境连接,验证硬件与软件的兼容性。但仿真环境需实时生成传感器信号(如摄像头图像、激光雷达点云),对算力的实时性要求极高。

:需在1ms内生成并传输传感器信号,否则会导致控制器接收到的数据“过时”。

:通过算力平台提供的RTOS(如QNX),将信号生成的延迟从5ms压缩至0.5ms,满足HIL测试的实时性要求。

:利用FPGA实现传感器信号的硬件生成,功耗比GPU低90%,同时支持多通道并行输出。

从多模态感知的实时处理到决策规划的数据驱动训练,从仿真测试的极端场景生成到HIL测试的硬件验证,算力服务正成为自动驾驶技术落地的关键支撑。其核心价值在于:

:通过云算力替代自建数据中心,降低研发成本(据测算,可节省60%以上的算力投入);

:通过弹性扩缩容与并行计算,缩短研发周期(如模型训练时间从月级压缩至周级);

:降低AI与仿真技术的落地门槛,推动自动驾驶从“辅助驾驶”向“完全无人”演进。

极目政情丨张升民任中共中央军事委员会副主席,2017年获授上将军衔,曾是“打虎干将”刘源继任者

中国女子在迪拜偶遇浙C牌越野车,车主:花50天从温州开2万多公里来的,花了五六十万元

突发!宗馥莉辞职41天后,有经销商收通知:明年继续卖娃哈哈;此前有娃哈哈经销商称被要求不能代理“娃小宗”

独家|对话北京人形机器人创新中心CTO唐剑:世界模型有望带来具身智能的“DeepSeek时刻”

《编码物候》展览开幕 北京时代美术馆以科学艺术解读数字与生物交织的宇宙节律

REDMI K90搭载超级像素屏:国产技术 全球领先让OLED进入无损时代

雷鸟Air 4发布:1599元起 全球首颗AR画质芯片 支持HDR画质显示我是PG电子新手,有没有简单的入门指南?